AIMC课题组研究成果被多媒体顶会ACMMM 2023录用

9728太阳集团人工智能与媒体计算课题组(AIMC Lab)关于开放场景多模态学习与评测的研究工作被2023年国际多媒体大会(ACMMM)长文录用。ACMMM是中国计算机学会推荐的多媒体领域A类国际学术会议。论文第一作者是太阳集团2019级博士生陈坳珠。

论文题目:ChinaOpen: A Dataset for Open-world Multimodal Learning

论文作者:陈坳珠,王子源,董程博,田凯彬,赵瑞祥,梁循,康战辉,李锡荣

通讯作者:李锡荣

论文概述:

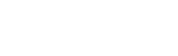

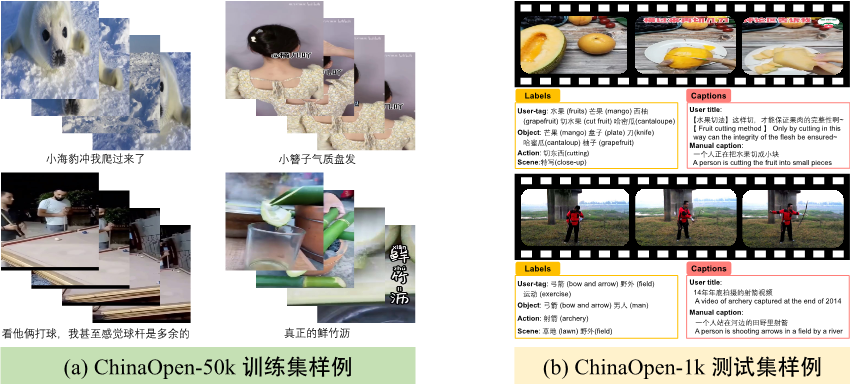

随着大语言模型和多模态大模型的出现和应用,学术界和工业界在视频自动标记 (video tagging)、视频描述生成 (video captioning)、跨模态视频检索 (text-to-video retrieval)等多个具有挑战性的视频内容理解和检索任务上均取得了明显进展,在任务特定的英文评测集上表现出了较好的性能。国内多家机构也陆续推出了中文多模态模型,比如用于跨模态图文匹配的CN-CLIP, Taiyi, ERNIE-ViL2和用于视觉描述生成的OFA-Chinese等。尽管如此,这些模型在真实开放场景下的有效性仍有待验证。针对上述问题,本文基于B站数据构建了一个名为ChinaOpen的中文短视频研究数据集,用于开放场景多模态学习和多任务评测。该数据集由两部分组成,分别是弱标注训练集ChinaOpen-50k和人工标注测试集ChinaOpen-1k。ChinaOpen-50k的构建流程采用了包括文本分析、人脸识别、视频内容识别、视频标签相关性学习等多项关键技术,对原始B站数据进行自动清洗,从而提升训练数据质量。ChinaOpen-1k的每个视频带有不同维度的人工标注数据,包括i) 经人工核验的用户标题和标签、ii) 关于视频内容的一句话描述、iii) 视频中主要物体 (object) /动作(action)/场景 (scene)对应的标签等。上述多维度标注使得ChinaOpen-1k相比现有以英文为主的数据集有明显的独特性,即可用于评测特定模型关于客观或主观描述视频内容的能力,也可用于评测模型在视频内容自动标记以及辅助用户标记的能力。此外,ChinaOpen-1k的中文标注已人工翻译成英文,因此也适用于评测英文多模态模型。

ChinaOpen下载网址:https://ruc-aimc-lab.github.io/ChinaOpen/

本项研究受国家自然科学基金面上项目(62172420)、2022腾讯下一代广告系统犀牛鸟重点研究计划、9728太阳集团校级计算平台支持。

论文信息: Aozhu Chen, Ziyuan Wang, Chengbo Dong, Kaibin Tian, Ruixiang Zhao, Xun Liang, Zhanhui Kang, Xirong Li, ChinaOpen: A Dataset for Open-world Multimodal Learning, ACMMM 2023

作者简介:

陈坳珠,9728太阳集团2019级博士生,导师为李锡荣教授,她的研究方向为视频检索。

李锡荣,9728太阳集团数据工程与知识工程教育部重点实验室教授、博导,9728太阳集团人工智能与媒体计算课题组负责人。主要研究兴趣包括多媒体智能、计算机视觉、模式识别、AI辅助诊断等,在相关领域重要国际刊物上累计发表学术论文百余篇,谷歌学术引用5000余次。曾任国际多媒体建模会议Multimedia Modeling 2021 Program Co-Chair。目前担任ACM TOMM、Multimedia Systems、IET Computer Vision等多个国际SCI期刊的编委。